Beszélünk róla, de talán még mindig nem eleget. A mesterséges intelligencia korában a deepfake-képek és -videók több mint 90 százaléka pornótartalom, szereplőik túlnyomórészt pedig olyan nők és lányok, akiket nem kérdeztek meg arról, akarják-e, hogy az arcuk egy pornófelvételen szerepeljen. Az RTL+-on most bemutatott Egy másik test című dokumentumfilmet a saját jól felfogott érdekünk végignézni.

A digitális tudatosságnak különböző szintjei és dimenziói vannak. Kezdve attól, hogy milyen jelszavakat vagy böngészőt használunk, addig, hogy a gyerekünkről milyen képeket töltünk fel a közösségi médiába, számtalan aspektusukkal tisztában kell lennünk az online világból ránk leselkedő veszélyeknek, és ezekkel szemben egyesével kellene a lehető legalaposabban felvértezve lennünk. Ám valójában olyan szintű, állandó éberséget kíván meg tőlünk a saját virtuális jelenlétünk feletti kontroll, hogy nehezen hibáztatható bárki is azért, ha nem tud egyszerre mindenre odafigyelni, és mondjuk, egy óvatlan, büszke pillanatában kiteszi a gyerekéről a mosolygós fotót. Az is érthető, ha a mesterséges intelligencia legsötétebb bugyraiban leledző deepfake-jelenséggel már végképp nincs kapacitása az embernek foglalkozni, és betudja azt a nagy emberek, politikusok vagy Taylor Swift problémájának.

Az MI segítségével készült hamis, manipulált tartalom már Joe Bidenről, Emmanuel Macronról, Tom Cruise-ról, Swiften kívül Billie Eilishról vagy Greta Thunbergről is, és legutóbb a brit médiaszolgáltató, a Channel 4 elemzése során derült ki, hogy az öt leglátogatottabb, deepfake-videókat kínáló weboldalon három hónap alatt mintegy 4000 híres ember arcképét használták fel. Színésznők, youtuberek, zenészek és televíziós személyiségek képmása a hozzájárulásuk nélkül került rá pornográf felvételekre.

De bármennyire is úgy tűnik, hogy a deepfake csak a celebritásokat fenyegeti, valójában az ilyen tartalmakat gyártók célkeresztjében ott vagyunk mi, civilek is.

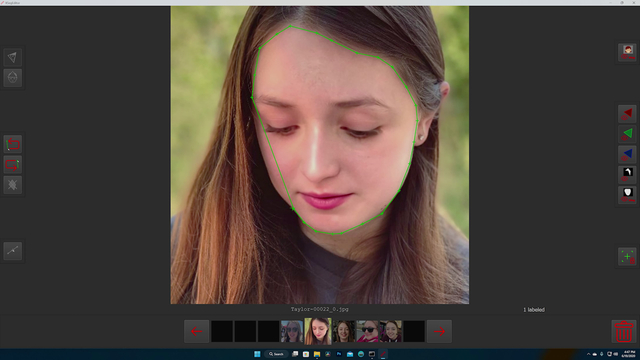

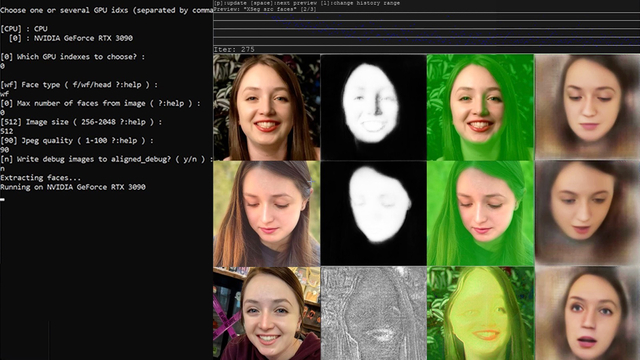

Erre mutat rá az RTL+-ra most felkerült Egy másik test című dokumentumfilm, amelynek a főszereplője, a főiskolás Taylor számára egyszer csak világossá válik, hogy a közösségi médiába gyanútlanul feltöltött fotóit, videóit valaki a beleegyezése nélkül pornóvideók készítéséhez használta fel, és algoritmus által generált, hamis pornófelvételek keringenek róla a PornHubhoz hasonló videómegosztó oldalakon. Ráadásul az is a tudomására jut, hogy nem csupán szextartalom készült az ő tudta nélkül a saját arcának felhasználásával, de kikerült a pornóoldalakra a neve és a lakcíme is.

Taylor – akinek nem ez a valódi neve, és az arcát is megváltoztatták a filmben, hogy ne derüljön ki az igazi identitása – attól kezdve, hogy megkapja egy ismerősétől a PornHub-linket, amely látszólag egy vele készült szexvideóra mutat, egy pillanat leforgása alatt válik teljesen kiszolgáltatottá és eszköztelenné.

Gyorsan kiderül számára, hogy hiába fordul a rendőrséghez, a hatóságok segítségére nem számíthat, mivel azok nem tudják lenyomozni a deepfake-videók készítőjét, de ha le is tudnák, akkor sem tehetnének sokat, az ilyen tartalmak generálása ugyanis nem számít bűncselekménynek abban az amerikai államban, ahol Taylor él (a filmet 2020-ban forgatták). Így, bár teljes nonszensz, de végül a diák és az ugyancsak áldozat barátnője a saját kezükbe veszik az ügyüket, és elvégzik a rendőrség munkáját, vagyis ketten felkutatják az elkövetőt. A film az ő nyomozásuk története és egyben tanmese is arról, hogy személyes és intézményes szinten sem vagyunk egyáltalán felkészülve az efféle online atrocitásokra.

Az Egy másik test készítői, Sophie Compton és Reuben Hamlyn 2017 óta kísérik figyelemmel a deepfake-jelenség fejlődését és hatásait, és filmjükből pontosan kiderül, hogy csak az van biztonságban, aki soha egyetlen felvételt sem töltött fel magáról a netre, vagy akiről soha egyetlen felvételt sem tettek fel az éterbe.

Egy másik fontos állítása a filmnek, hogy a deepfake-pornó igenis az online erőszak egy formája (az elkövető digitális eszközöket használ fel az agresszió elkövetésére, amellyel fizikai, szexuális, lelki sérülést vagy gazdasági kárt okoz), még ha ezt a nemzetközi szabályozás valahogy nehezen is emészti meg. Taylornak komoly pszichés problémákat okoz az ellene elkövetett virtuális abúzus, az egészsége látja kárát annak, hogy elveszíti az irányítását a saját online reprezentációja fölött, ám nincs beépítve a rendszerbe semmilyen olyan elem, ahova a hatékony fellépés érdekében fordulni tudna.

A deepfake-pornónak, mint abúzusnak, neme van – nyomatékosít a film. Érdemes tudatosítani, hogy ez a nők elleni erőszak egyik újabb formája. Bár vannak férfi áldozatok is, és sokan azt hiszik, hogy a legfőbb célpontok a politikusok, a deepfake-et jellemzően nők megszégyenítésére és elhallgattatására használják fel. Taylorékon egy közeli barát, egy fiú évfolyamtárs áll piti bosszút a hamis tartalmak terjesztésével. A róluk szóló dokumentumfilm készítői szerint a világhálón már háromezernél is több olyan weboldal található, ahol deepfake-videókat terjesztenek, a tartalmak száma pedig félévente megduplázódik, 2024-ben meghaladhatja az ötmilliót.

Ezeknek a videóknak a 98 százaléka pornófelvétel, az áldozatoknak pedig a 99 százaléka nő.

A The Conversation cikke szerint az egyik legnépszerűbb, a szexualizált deepfake-videóknak és -képeknek szentelt honlapot havonta mintegy 17 millióan látogatják. Az itt kínált tartalmakban szinte kizárólag nők vannak. Mindezzel párhuzamosan exponenciálisan emelkedik a „vetkőztetős applikációk” népszerűsége is, ezek ugyancsak a mesterséges intelligencia segítségével, egy gombnyomásra generálnak pucér képeket az amúgy ruhában lévő emberekről. Itt sem árulunk el titkot, ha azt mondjuk: jellemzően nőket, lányokat fosztanak meg digitálisan a ruháiktól.

A deepfake-pornó generálásához nem kell túl nagy szakértelem, és pénz sem igazán, elég csak egyetlen jó minőségű kép a kiválasztott alanyról, és a statisztikák szerint már kevesebb mint 25 perc alatt össze lehet rakni egy rövid, egyperces manipulált pornóvideót. Egy 2023-as felmérés szerint az amerikai férfiak 48 százaléka nézett már életében deepfake-pornót, és kétharmaduk nem érezte a dolgot problémásnak, mondván: az ilyen szexvideók készítése mindössze a szexuális fantázia kiéléséről szól, ártalmatlan tevékenység, főként azért, mert a felhasználók általában tisztában vannak azzal, hogy egy algoritmus generálta aktust néznek, nem a valóságot.

Holott a műfajtól a lehető legtávolabb áll az „ártalmatlan” jelző. Az ilyen tartalmakkal például kiválóan lehet zsarolni a célszemélyeket. Ezenkívül sértik a nők integritásához, autonómiához való jogát, visszaélnek a személyes adataikkal. Nem véletlen, hogy amikor a Channel 4 kutatása során a szolgáltató egyik műsorvezetője is megpillantotta a saját arcát egy pornóvideóban, azt mondta, hogy úgy érezte magát, mint akit „megbecstelenítettek”.

Az ilyen deepfake-videók nagy része tehát messze nem(csak) a szexuális fantáziáról, hanem jóval inkább a nők feletti hatalomról, a megalázásukról szól.

A probléma az, hogy a deepfake-bizniszben meglehetősen sokan érdekeltek, és amíg ez így van, nehéz elképzelni, hogy igazán szigorú intézkedésekkel háttérbe szorítsák a problémás tartalmakat.

Patricia Gestoso, a nők és más kisebbségi csoportok vállalati esélyegyenlőségéért dolgozó stratéga egy blogposztban szedte össze, hogy ki mindenki jár jól a deepfake-pornóval. Jól jár nyilván az alkotó, aki akár pénzért is eladhatja az általa készített tartalmat a nagy deepfake-platformok valamelyikének. Jól járnak maguk a weboldalak; a képgeneráló szoftverek gyártói (a Taylor Swift arcát felhasználó deepfake-pornót a Microsoft eszközével csinálták); a webtárhely-szolgáltatók (például az Amazon), amelyeket gyakran használnak a weboldalak működtetéséhez; az online piacterek, ahol például MI-generálta pornóképek cserélnek gazdát; az App Store és a Google Play, ahonnan a deepfake-alkalmazások letölthetők; a keresőmotorok, amelyeken keresztül a felhasználók egy tetemes része eljut a kívánt tartalomig; és a közösségi média tulajdonosai is. Az öt legnagyobb deepfake-weboldal látogatóinak 70 százaléka a Google keresőmotorját használva talált rá az oldalakra a Channel 4 kutatása szerint.

A Facebookon és az Instagramon pedig több mint 230 szexuális célú deepfake-hirdetés futott csak 2023 márciusában Emma Watson és Scarlett Johansson arcát felhasználva. A Metának két napba telt, mire eltávolította ezeket a hirdetéseket. Aztán az X (korábbi nevén Twitter) felhasználói is rendszeresen terjesztik a deepfake-tartalmakat, noha a platform irányelvei tiltják a manipulált felvételek közzétételét. Ehhez képest 2023 első és második negyedéve között a deepfake-tartalomhoz kapcsolódó tweetek száma 25 százalékkal ugrott meg.

A jogi szabályozás – ahogy az a filmbeli Taylorék példájából is látszik – még mindig nem egységes, és nem nőtt fel a feladathoz. A briteknél a deepfake-pornó terjesztését például tiltják, az előállítását azonban nem. Az Európai Unió törvényhozói már jóváhagyták a mesterséges intelligenciáról szóló törvényt, de az leginkább csak azt írja elő, hogy a manipulált képi, videó- és hangtartalmakat jelölni kell. És míg Hollandiában vagy az ausztráliai Victoria államban már büntetik a szexualizált deepfake-ek beleegyezés nélküli előállítását, az Egyesült Államokban még e tekintetben nincs teljes egyetértés, noha fontolgatnak szövetségi törvényt arról, hogy az áldozatoknak joguk legyen kártérítésért vagy a jogsértés megszüntetéséért polgári bíróságon perelni. Ez a gyakorlat már elvileg működik Texasban, ahol kriminalizálták a deepfake-pornó alkotását is.